La Singolarità può, più specificamente, riferirsi all’avvento di una intelligenza superiore a quella umana, e ai progressi tecnologici che, a cascata, si presume seguirebbero, salvo un importante aumento artificiale delle facoltà intellettive di ciascun individuo.

Il saggio di Vinge (matematico e romanziere) contiene l’affermazione spesso citata che “Entro trenta anni, avremo i mezzi tecnologici per creare una intelligenza superumana. Poco dopo, l’era degli esseri umani finirà.”

La singolarità di Vinge è comunemente ed erroneamente interpretata come l’affermazione che il progresso tecnologico crescerà all’infinito, come avviene in una singolarità matematica. In realtà, il termine è stato scelto come una metafora prendendolo dalla fisica e non dalla matematica: mentre ci si avvicina alla Singolarità, i modelli di previsione del futuro diventano meno affidabili, esattamente come i modelli della fisica vanno a pezzi mentre ci si avvicina ad una singolarità gravitazionale.

La Singolarità è spesso vista come la fine della civilizzazione umana e la nascita di una nuova civiltà. Nel suo saggio, Vinge chiede perché l’era umana dovrebbe finire, e argomenta che gli umani saranno trasformati durante la Singolarità in una forma di intelligenza superiore. Dopo la creazione di un’intelligenza superumana, secondo Vinge, la gente sarà, al suo confronto, una forma di vita inferiore.

L’analisi storica del progresso tecnologico dimostra che, l’evoluzione della tecnologia, segue un processo esponenziale e non lineare come invece si sarebbe portati a pensare. Nel suo saggio, The Law of Accelerating Returns, Ray Kurzweil propone una generalizzazione della Legge di Moore che forma la base delle convinzioni di molta gente a riguardo della Singolarità. La Legge di Moore descrive un andamento esponenziale della crescita della complessità dei circuiti integrati a semiconduttore. Kurzweil estende questo andamento includendo tecnologie molto precedenti ai circuiti integrati ed estendendolo al futuro. Egli crede che la crescita esponenziale della legge di Moore continuerà oltre l’utilizzo dei circuiti integrati, con l’utilizzo di tecnologie che guideranno alla Singolarità.

Alcuni presumono che una sempre più rapida crescita tecnologica arriverà con lo sviluppo di una intelligenza superumana, sia potenziando direttamente le menti umane (forse con la cibernetica), o costruendo intelligenze artificiali. Queste intelligenze superumane sarebbero presumibilmente capaci di inventare modi di potenziare se stesse anche più velocemente, producendo un effetto feedback che sorpasserebbe le intelligenze preesistenti.

Semplicemente avere una intelligenza artificiale allo stesso livello di quella umana, presumono altri, potrebbe produrre lo stesso effetto, se la Legge di Kurzweil continua indefinitamente. All’inizio, si suppone, una simile intelligenza dovrebbe essere pari a quella umana. Diciotto mesi dopo sarebbe due volte più veloce. Tre anni dopo, sarebbe quattro volte più veloce, e così via. Ma dato che le Intelligenze Artificiali accelerate stanno, in quel momento, progettando i computer, ogni passo successivo impiegherebbe circa diciotto mesi soggettivi per sempre, come sarebbe richiesto per produrre, in questo modo, una intelligenza realmente infinita. e proporzionalmente meno tempo reale ad ogni passo. Se la Legge di Kurzweil continua ad applicarsi senza modifiche, ogni passo richiederebbe metà del tempo. In tre anni (36 mesi = 18 + 9 + 4,5 + 2,25 + …) la velocità del computer, teoricamente, raggiungerebbe l’infinito. Questo esempio è illustrativo, e comunque, molti futurologi concordano che non si può presumere che la legge di Kurzweil sia valida anche durante la Singolarità, o che essa possa rimanere vera letteralmente

Una intelligenza artificiale capace di migliorare sé stessa in modo ricorsivo oltre il livello dell’intelligenza umana, conosciuta come una seed AI (seme), se possibile, causerebbe probabilmente una singolarità tecnologica. Semplicemente una di queste AI, credono in molti, sarebbe necessaria per produrre la Singolarità. La maggioranza dei Singolaritisti credono che la creazione di una seed AI sia il mezzo più probabile con il quale l’umanità raggiungerà la Singolarità. Molto del lavoro del Singularity Institute è fondato su questa premessa.

I pericoli potenziali della nanotecnologia sono ampiamente conosciuti anche al di fuori dei circoli dei futurologi e dei transumanisti, e molti Singolaritisti considerano la nanotecnologia controllata dagli uomini come uno dei maggiori rischi esistenziali che l’umanità si trova di fronte. Per questa ragione, spesso essi credono che la nanotecnologia dovrebbe essere preceduta dalla seed AI, e che la nanotecnologia non dovrebbe essere a disposizione delle società prima della Singolarità.

Altri sostengono gli sforzi per creare una nanotecnologia molecolare o zettatecnologia, credendo che la nanotecnologia può essere sicura anche se usata prima della Singolarità o può accelerare l’arrivo di una singolarità benefica.

Altre tecnologie, (ad es. una struttura di comunicazione connessa globalmente a banda elevata e senza fili; una rete di computer infetti da virus o worm interconnessi tra loro), sebbene non siano, probabilmente, in grado di produrre una singolarità di per sé stesse, sono considerate come segni di un livello di avanzamento tecnologico che produrrà la Singolarità.

Per alcuni, una delle tecnologie più anticipate è la possibilità di potenziamento dell’intelligenza umana:

- Interfacce dirette mente-computer potenzialmente potrebbero aumentare la memoria degli individui, la loro capacità elaborativa, l’abilità comunicativa, e le conoscenze. Anche una interfaccia tra computer e uomo più tradizionale potrebbe essere vista come un progresso che aumenta l’intelligenza: i sistemi esperti tradizionali, i sistemi di computer che riconoscono e prevedono il comportamento umano, il software di riconoscimento vocale e di riconoscimento della scrittura, etc.

L’aumento dell’intelligenza attraverso i nuovi medicinali e l’ingegneria genetica potrebbe anche diventare una possibilità per gli umani esistenti, oltre a quello che è permesso dalle moderne sostanze nootropiche. Ai neonati potrebbe essere migliorata l’intelligenza nello stesso modo

Sebbene la seed AI e la nanotecnologia siano considerate le più probabili tecnologie che possano produrre una Singolarità, altri hanno speculato sulla possibiltà che altre tecnologie avanzate arrivino prima della Singolarità. Queste tecnologie, sebbene improbabili, sono spesso utilizzate da alcuni futurologi (come Ray Kurzweil) come una “prova” della Singolarità — anche se la seed AI e la nanotecnologia molecolare non saranno state inventate entro la fine del XXI secolo, altre tecnologie potrebbero causare la Singolarità.

Il Mind uploading, per esempio, è un metodo alternativo proposto per creare una intelligenza artificiale — invece di programmare una intelligenza, essa sarebbe prodotta partendo dall’intelligenza umana già esistente. Comunque, il livello tecnologico necessario per scannerizzare il cervello umano alla risoluzione necessaria per un mind upload rende improbabile il mind uploading in un mondo pre Singolarità. La capacità elaborative dei computer e la comprensione delle scienze cognitive necessarie è anche fondamentale.

Altri, come George Dyson in Darwin Among the Machines, hanno speculato che una rete di computer sufficientemente complessa potrebbe produrre una “swarm intelligence“. Gli sviluppatori dedicati all’AI potrebbero utilizzare le accresciute capacità elaborative per creare reti neurali artificiali così grandi e potenti che potrebbero diventare genericamente intelligenti. I sostenitori della Intelligenza Artificiale Amichevole vedono questo come un tentativo di risolvere il problema di creare una AI utilizzando la “forza-bruta” (testando, letteralmente, tutte le possibilità fino a che non si ottiene il risultato voluto), e un modo che potrebbe produrre forme di intelligenza artificiale inacettabilmente pericolose.

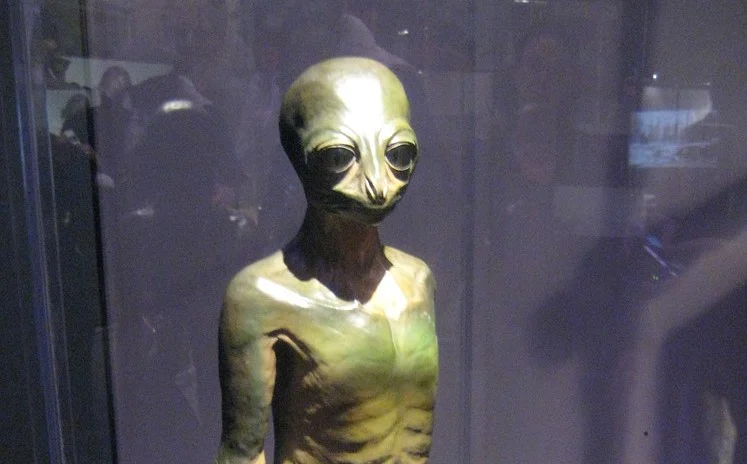

In questo servizio, tratto dalla trasmissione La Gaia Scienza, i futurologi parlano appunto di queste straordinarie tecnologie che possono sì migliorare il futuro ma sono molto pericolose.